Trumpinizacija AI?

- Tamara Zavišić

- May 14

- 4 min read

Kad svi igraju za isti tim, nema ko da svira faul. I to je tako.

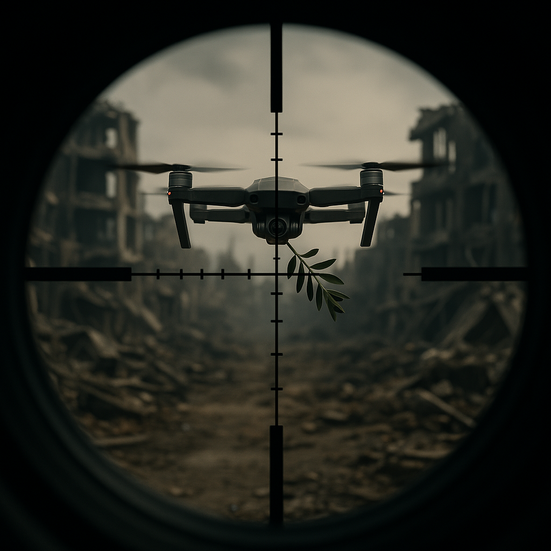

Povratak Donalda Trumpa u Belu kuću početkom 2025. označio je preokret u američkoj politici prema veštačkoj inteligenciji. I to ne tiho, već uz fanfare, dekret i solidnu dozu deregulatornog entuzijazma. Istina.

Novi mandat, stari stil. Uklanjanje „štetnih“ (po industriju) prepreka. Favorizovanje tržišnog razvoja. Signal industriji da sloboda inovacije sada ima predsednički pečat.

Već u januaru (čekalo se nije), Trump je potpisao izvršnu uredbu kojom je opozvao ključne AI smernice prethodne administracije. Bidenov Blueprint for an AI Bill of Rights, zajedno sa NIST-ovim standardima pravičnosti i bezbednosti, završio je u fioci, a federalne agencije dobile su zadatak da preispitaju sve što je „smetalo“ američkom vođstvu u AI industriji. U zamenu – fleksibilne, neobavezujuće smernice i oslonac na „zdrav razum“ tržišta. Ideološke pristrasnosti, navodne ili stvarne, označene su kao nova meta: AI mora biti „oslobođen društvenih agendi“, kako uredba kaže, jer (očigledno) ideologija je opasnija od algoritma.

Regulativa na dijeti?

Trumpov AI kurs favorizuje industrijsku samoregulaciju: manje pravila, više tržišnih impulsa. Umesto obaveznih bezbednosnih testova, uvodi se poverenje. Umesto nadzora nad algoritamskom diskriminacijom – očekivanje da kompanije same razviju kodekse ponašanja.

FTC i druge agencije dobile su zadatak da „ne smetaju“. To ne znači da se sve briše – u osetljivim oblastima, poput zdravstva ili saobraćaja, moguće su „minimalne zaštitne mere“ – ali opšti duh politike jeste: neka se AI razvija bez balasta.

Ovakav pristup izaziva reakcije na nivou saveznih država. Kalifornija i Njujork najavljuju sopstvene zakone, što znači da umesto jedne regulative dobijamo mozaik propisa, koji u praksi stvara komplikovano okruženje za kompanije. Otkud? Trumpov tim najavljuje borbu protiv toga – uključujući i opciju federalnog zakona koji bi preemptovao lokalne standarde, ali za sada sve ostaje na najavi. Čekamo.

Kadrovska simbolika?

Na mesto AI savetnika dolazi David Sacks – poznat kao zagovornik „light-touch“ regulative i slobodnog tržišta, uz Muskovo neformalno mentorstvo iz senke. Bromance indeed. Sacks će, očekuje se, fokus usmeriti na primene, ne na modele. Pristup: ne regulišemo samu tehnologiju, već samo ono što može da eksplodira (doslovno ili metaforički?). Musk, sada i formalni savetnik, unosi dodatnu dozu kontradikcije – poziva na bezbednosne guardrails, ali i napada „woke“ algoritamske filtere.

Potpredsednik J.D. Vance daje međunarodni ton: u Parizu otvoreno napada EU regulative i poručuje da će SAD „ići svojim putem“. Taj put je (očekivano) deregulisan, decentralizovan, sa viškom slobode govora i manjkom filtera.

Autorska prava?

Trumpov tim nagoveštava popustljivost prema korišćenju zaštićenog sadržaja za treniranje modela. Sudski sporovi su u toku, ali stav administracije je jasan: AI mora imati pristup podacima – čak i ako su oni tehnički nečiji. Fer korišćenje dobija široku interpretaciju, a pitanje da li prompt može da bude „autorski doprinos“ možda će dobiti novi tretman. U svakom slučaju, autorska prava neće biti kamen spoticanja američkoj AI industriji – makar ne u ovom mandatu.

Pominjala sam i pisala o tome da je Trumpova administracija smenila šeficu AI Copyright Office-a.

Zašto?

Smenjena je neposredno nakon objavljivanja izveštaja koji dovodi u pitanje zakonitost korišćenja zaštićenih autorskih dela za treniranje veštačke inteligencije. Ovaj izveštaj sugeriše da komercijalna upotreba velikih količina zaštićenih sadržaja za generisanje konkurentskog izražajnog sadržaja prevazilazi granice dozvoljene pod doktrinom "fer upotrebe"

Ako se pravila kroje prema interesima najglasnijih, onda je pitanje autorskih prava samo prvi u nizu regulatornih domino efekata. A biće ih.

AI etika?

Trumpova administracija ne veruje u „AI etiku“ kao set pravila. Tačka. Umesto toga, vraća se na osnove: primena postojećih zakona (ako i kada dođe do problema) i izbegavanje obaveznih evaluacija pristrasnosti, objašnjivosti ili uticaja. Etika je delegirana industriji – što nije nužno loše, ali zahteva visok stepen poverenja. Upitno svakako.

Paralelno, novi fokus etike postaje „ideološka neutralnost“ – odnosno borba protiv percepcije da AI alati favorizuju određene političke stavove. U praksi, to može značiti pritisak da se modeli ponašaju „neutralno“, čak i kada to znači ignorisanje društvenih nejednakosti koje modeli zapravo odražavaju.

AI u politici?

Veštačka inteligencija se već koristi u političkim kampanjama (čak i kod nas), a Trumpova svakako ne zazire od toga. Satirične AI verzije poznatih ličnosti, manipulativni video-sadržaji i automatizovani botovi nisu incidenti – oni su deo političkog arsenala. Administracija ne pokazuje interesovanje za regulisanje AI sadržaja u političkom prostoru – naprotiv, poziva se na slobodu izražavanja. Fokus ostaje na stranom uticaju, dok domaći deepfake sadržaji ostaju (barem za sada) izvan domašaja propisa.

Indeks oduševljenja Silicijumske doline?

Industrija reaguje pozitivno – manje pravila, više manevarskog prostora. OpenAI, Google, Meta i drugi giganti dobijaju jasnu poruku: država neće zadirati u razvoj modela, dokle god se poštuju osnovne bezbednosne smernice. Startup ekosistem diše lakše (zato nam i odoše ljudi tamo), a konglomerati balansiraju između američkog deregulatornog pristupa i evropskih regulatornih ambicija. Zabrinutost postoji – ali više zbog pravnog haosa nego zbog ideoloških neslaganja.

Novo lice OpenAI?

U svetlu političkog zaokreta, OpenAI nije ostao po strani. Uuuu daleko od toga.

Odnedavno je sve primetnije da ChatGPT generiše sadržaje koje je do pre nekoliko meseci rutinski odbijao – uključujući eksplicitne političke komentare, pseudonaučne tvrdnje, pa i nasilne narative koji su ranije bili filtrirani kao protivni pravilima korišćenja.

Uočeni su primeri generisanja etički upitnih sadržaja, propagandnog sadržaja, konstruisanih istorijskih narativa i čak deepfake-style scenarija koji bi ranije bili označeni kao “unavailable due to policy restrictions.” A testirala sam, dabome.

Npr >

Itd, itd.

Ako vas interesuju tehnike promptovanja koje koristim za testiranje, pišite. ILI, čekajte jedan jako interesantan kurs koji spremamo - Krojačeva škola.

Elem, modeli takođe pokazuju veću spremnost da odgovore na etički sporna pitanja – od saveta za manipulaciju do komentara o kontroverznim temama koje su ranije bile „van granica“. To ne znači potpuni haos, ali svakako ukazuje na popuštanje internih ograničenja, u skladu sa tržišnom (i političkom?) klimom koja favorizuje deregulaciju. Jelte.

Nije isključeno da su promene u politici OpenAI-ja delimično odgovor na političke vetrove. Posebno u trenutku kada kompanije biraju između tržišnog opstanka i reputacijske sigurnosti. U svakom slučaju, primećuje se pomeranje: od stroge moderacije prema fleksibilnijem, a možda i opasnijem, pristupu slobodi izražavanja modela. Nije nužno loše, ali jeste promena.

Malo je i do nas. Kako koristimo alat. Budimo odgovorni.

Dakle, trumpinizacija AI?

Šta mislimo o ovome? Dobro, loše? (Ne)održivo?

Bez jasnih granica (bilo čvrstih, bilo fleksibilnih), inovacija lako postane izgovor. A biće ih. Mislim, izgovora.

Comments